ビジョン

2024年9月22日

「あなたのスタートアップは何をやっているんですか?」—— 創業者なら誰もがスラスラ答えられるはずのこの質問に、私は創業から3年、数えきれないほどの方向転換を経た今も、何度も立ち止まって考えています。

susuROBOを立ち上げた当初、私たちが会話型インターフェースの実現において最も大きな課題だと感じていたのは、「自然言語の理解・生成・対話管理」でした。 しかしその「きれいに分かれたNLPの構造」も、LLM(大規模言語モデル)の登場によって一変しました。

もはや「最重要課題項目」が週ごとに変わってしまうほど、LLMの普及により会話AIの進化はこれまでにないスピードで進んでいます。 だからこそ、私たちは常に自分たちの「北極星」——つまり進むべき方向を示すビジョンを見失わないようにしなければなりません。 ビジョンとは、具体的な製品でも、明確なスケジュールで達成できる目標でもありません。それは、プロダクト開発や事業判断のあらゆる分岐点で「正しい選択」をするための指針となります。

私たちのビジョンは、

「ユーザーインターフェースの進化を通じて、すべての人がAIを利用し、

その恩恵を受けられるようにすること」です。

なぜUIが重要なのか。テクノロジーをうまく使いこなすためには、ユーザーがその仕組みをある程度「頭の中で理解」している必要があります。 UIが優れていればいるほど、その理解(メンタルモデル)を築くための負担は小さくなります。

たとえばテキストでLLMとやり取りする場合、「LLMがどう動くか」という正しいメンタルモデルを持っていれば、 より良い回答を引き出す入力(いわゆるプロンプト)を工夫できます。 プロンプトエンジニアリングという言葉が生まれた背景には、その複雑さゆえに、一般の人々が尻込みしてしまう現実があります。

音声でAIと会話するとなると、さらに多くの層が加わります:

- 途中で割り込んでも大丈夫?

- 返答までどれくらい待てばいい?

- 聞き間違いがあった時、どう言い直せば伝わる?

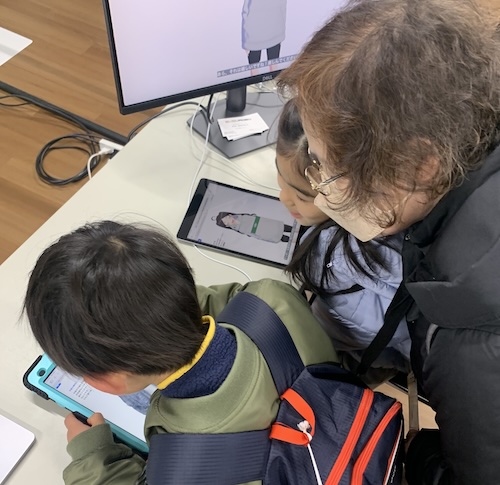

こうしたことを意識しながら話す必要があるのです。 Siriを上手に操って運転中にメールを送る「音声の達人」もいますが、そんな人はごく少数です。 実際、私たちの調査では、特に子どもや高齢者にとって音声でAIとやり取りするのは難しいことが分かっています。 しかし皮肉なことに、彼らこそ、文字入力が不便な分、音声インターフェースの恩恵を最も受けられる層でもあります。

人間は、こうしたギャップを「えーと」「うーん」といったフィラー(つなぎ言葉)や、 うなずき・視線などの非言語的な反応で自然に埋めています。 つまり、これらの人間的な振る舞いを会話AIにも取り入れることで、AIのアクセシビリティが高まり、 より多くの人がAIを自然に受け入れられるようになる——私たちはそう考えています。

次回の投稿では、これらの課題を具体的にどのように解決していくのかについて、さらに掘り下げていきます。